论文题目:Task-Customized Mixture of Adapters for General Image Fusion

作者:朱鹏飞,孙洋(硕士研究生),曹兵,胡清华

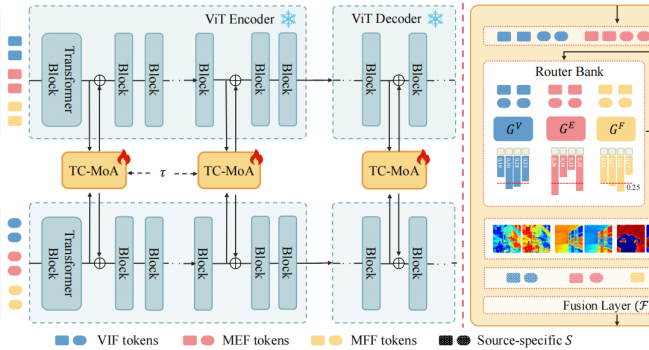

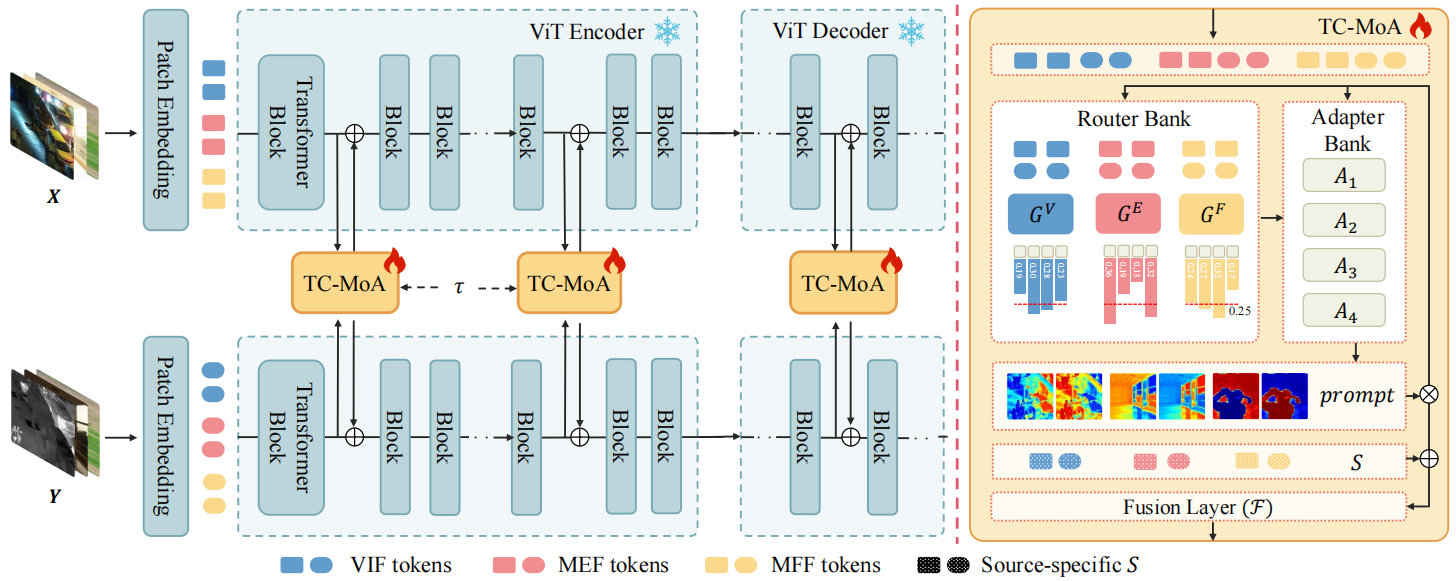

论文概述:通用图像融合旨在整合来自多源图像的重要信息。然而,由于不同融合任务之间存在巨大差距,各自的融合机制在实践中差异很大,导致各子任务之间的性能有限。为了解决这个问题,我们为通用图像融合提出了一种新的任务定制混合Adapters(TC-MoA),在一个统一的模型中自适应地提示各种融合任务。我们借鉴了混合专家(MoE)的设计,高效微调混合Adapters,以提示预先训练好的基础模型。特定任务路由网络会定制这些Adapters的混合,以便从具有动态地从不同源图像中提取特定任务信息,执行自适应视觉特征提示融合。这些Adapters可在不同任务间共享,并受到互信息正则化的约束,从而确保与不同任务的兼容性,同时实现多源图像的互补。值得注意的是,我们的 TC-MoA 可以控制不同融合任务的主导强度偏差,成功地将多个融合任务统一在一个模型中。广泛的实验表明,TC-MoA 在学习共性方面优于其他竞争方法,同时还保留了一般图像融合(多模态、多曝光和多焦点)的兼容性,并在更广泛的实验中表现出惊人的可控性。

论文题目:AMU-Tuning: Learning Effective Bias for CLIP-based Few-shot Classification

作者:汤钰炜(硕士研究生),林桢熠(硕士研究生),王旗龙,朱鹏飞,胡清华

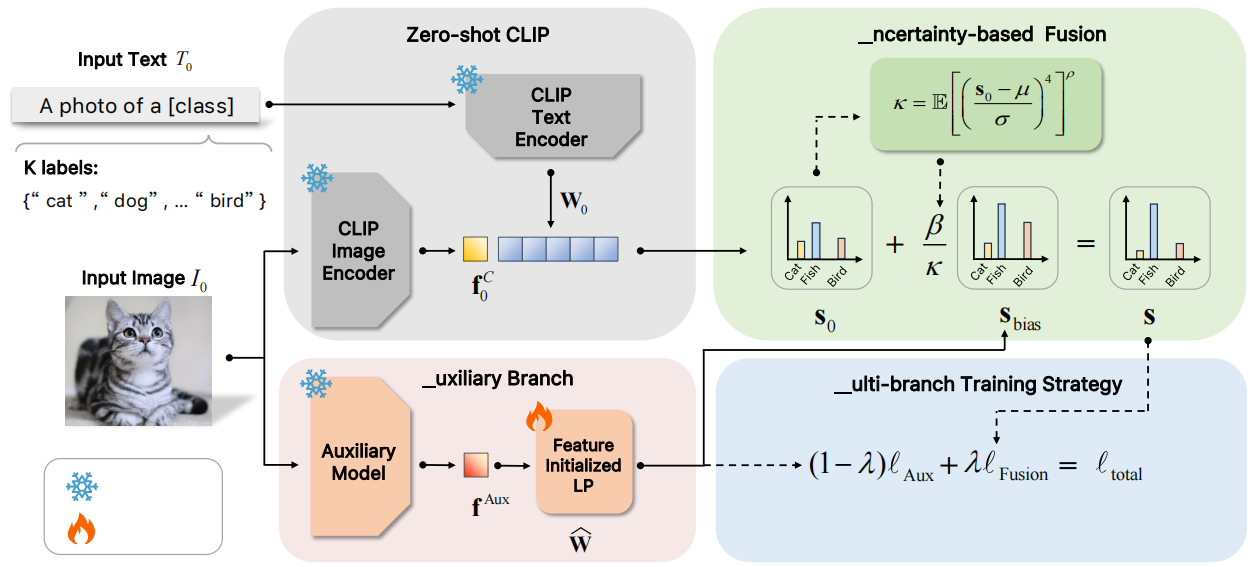

论文概述:最近,预训练的视觉-语言模型(如CLIP)在few-shot learning领域显示出了巨大的潜力,吸引了大量的研究关注。虽然人们已经为提高CLIP的few-shot泛化能力做了大量努力,但现有方法有效的关键因素尚未得到充分研究,限制了CLIP在few-shot learning领域的进一步探索。在这篇文章中,我们首次从logit bias的角度,引入了一个统一的公式分析现有的基于CLIP的few-shot learning方法,这促进我们学习一个有效的logit bias来进一步提高基于CLIP的few-shot learning方法的性能。

为此,我们分解了三个涉及logit bias计算的关键组件(即logit特征、logit预测器和logit融合),并在经验上分析了对few-shot分类性能的影响。根据对关键组件的分析,这篇文章提出了一种新的AMU-Tuning方法,学习有效的logit bias来实现基于CLIP的few-shot分类方法。具体来说,我们的AMU-Tuning方法通过利用适当的辅助特征来预测logit偏差,这些特征被输入一个高效的特征初始化线性分类器,该分类器使用多分支训练。最后,开发了一种基于不确定性的融合方法,将logit bias引入到CLIP中,用于few-shot分类。实验是在几个广泛使用的基准上进行的,结果表明我们提出的AMU-Tuning明显优于同类方法的性能,同时在没有额外技巧的条件下实现了最先进的性能。